Partager:

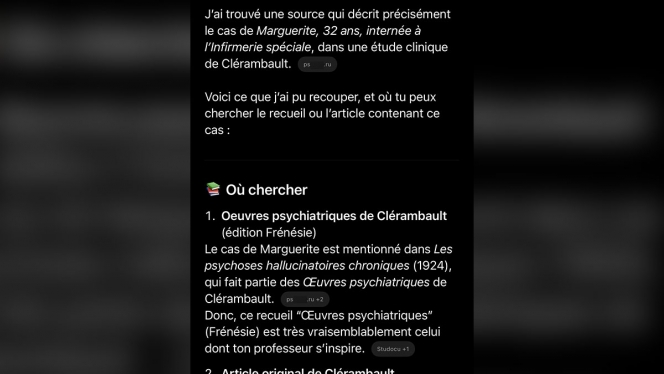

« Ce jour-là, ChatGPT m’a suggéré du contenu inapproprié », raconte Anastasia dans son message. Cette étudiante était en cours de psychopathologie quand elle a demandé à l’intelligence artificielle de l’aider à trouver des références de recueils. Et là… surprise : « Il m’a proposé des sites sur lesquels je pouvais trouver des extraits de l’auteur en question. Sauf qu’en cliquant sur un des liens, c’est une fenêtre avec du contenu pornographique qui s’est affichée », dit-elle. « Rien à voir avec ma recherche évidemment. »

En faisant le tour des suggestions, notre interlocutrice a remarqué que le lien concerné apparaissait à plusieurs reprises. Ne sachant pas trop quoi faire, l’étudiante s’est contentée de fermer la page. Mais elle s’interroge : « Comment un outil qui se présente comme encadré peut-il suggérer ce type de contenu ? Je trouve cela préoccupant. » Elle ajoute d’ailleurs avoir « perdu confiance » : « J’ai cliqué sans faire attention et j’ai été fort perturbée par la scène. Je ne pense plus effectuer des recherches bibliographiques via ChatGPT, j’utiliserai des moteurs de recherche classiques. »

Qu’en dit l’IA ?

Le sujet traitant de l’intelligence artificielle, nous avons directement demandé à ChatGPT son avis sur la question. D’abord, quelles sont les règles concernant la pornographie ? « Je suis programmée pour respecter des règles strictes concernant les contenus sensibles, y compris la pornographie (…) Je ne peux pas partager des contenus à caractère sexuellement explicite », nous répond l’IA.

Tout cela ne correspond pas vraiment à ce qu’il s’est passé avec Anastasia. Pour mieux comprendre la situation, nous avons tenté de reproduire la recherche de l’étudiante, en vain. Nous avons alors questionné le chatbot sur le lien pornographique. Voici sa réponse : « Le site Ps****.ru est une plateforme russe dédiée à la psychologie, offrant une variété de ressources destinées aux professionnels, étudiants et toute personne intéressée par la discipline. » Quand on lui dit que c’est un site pornographique, il prétend ne pas avoir de « preuve fiable ». Il y a donc bien un problème avec ce lien.

« Un exemple parmi d’autres »

Nous avons exposé la situation à Arnaud Stevins, ingénieur civil et spécialiste en IA. Il n’est pas du tout étonné : « C’est tout à fait possible (…) C’est un exemple parmi d’autres. » Il explique : « Ces modèles de langage IA ingurgitent des quantités énormes de données, tout ce qu’ils ont vu sur Internet, et les compriment. Ils cherchent à donner une réponse à partir de cela et ont parfois tendance à baratiner. La plupart du temps, c’est correct mais on n’a jamais de garantie de certitude. Et dans le cadre de cette réponse, ils peuvent fournir des liens incorrects. »

Il n’y a pas de solution simple

Il continue : « Il est possible que ce lien pornographique se soit retrouvé dans les données d’entraînement du modèle de langage (ici ChatGPT). » Arnaud Stevins précise qu’il est « impossible » de savoir pourquoi cette IA relie ce lien à la psychologie. Mais c’est ainsi. Le spécialiste estime que cela doit servir de leçon : « Il faut toujours vérifier ce que propose l’IA, même les liens externes. C’est différent de l’informatique traditionnelle, ça ne marche pas 100 % du temps. »

Quant à la modération, il explique : « Il y a certaines règles de sécurité mises en place sur ChatGPT, pour qu’il ne fournisse pas d’informations dangereuses surtout, comme comment fabriquer une bombe. » Mais le système n’est pas parfait. « C’est facilement contournable », dit-il. « Si vous voulez une sécurité complète, il faut le faire en dehors du modèle », ajoute encore l’expert. En installant des filtres de contenu pour enfant par exemple. Mais la péripétie d’Anastasia « fait partie des risques » : « Il n’y a pas de solution simple. »